CAT-Net

约 4963 字大约 17 分钟

2026-03-22

CAT-Net: Compression Artifact Tracing Network for Detection and Localization of Image Splicing

Myung-Joon Kwon, In-Jae Yu, Seung-Hun Nam, and Heung-Kyu Lee

韩国科学技术院

摘要

检测并定位图像拼接已成为打击恶意伪造行为的关键技术。定位拼接区域的主要挑战在于区分具有压缩伪影等固有特征的真实区域与篡改区域。我们提出CAT-Net框架:一种端到端全卷积神经网络,整合RGB和DCT数据流,通过联合学习RGB与DCT域上的压缩伪影特征实现精准定位。各数据流采用多分辨率处理技术,有效应对拼接对象的多样化形状与尺寸特征。DCT数据流通过双JPEG检测模型进行预训练,充分利用JPEG图像特有的伪影特征。实验结果表明,该方法在JPEG或非JPEG图像拼接区域定位任务中,性能表现优于现有最先进的神经网络模型。

1.引言

现代移动设备让任何人都能随时随地拍摄照片。得益于用户友好的图像编辑软件,图片处理变得异常便捷,而社交网络服务更能让照片秒速传播。尽管这些技术进步极大便利了人们生活,但伪造图像被用于制造假新闻、虚假宣传或伪造证据等问题也随之凸显[44]。因此,图像篡改检测技术的重要性与日俱增。

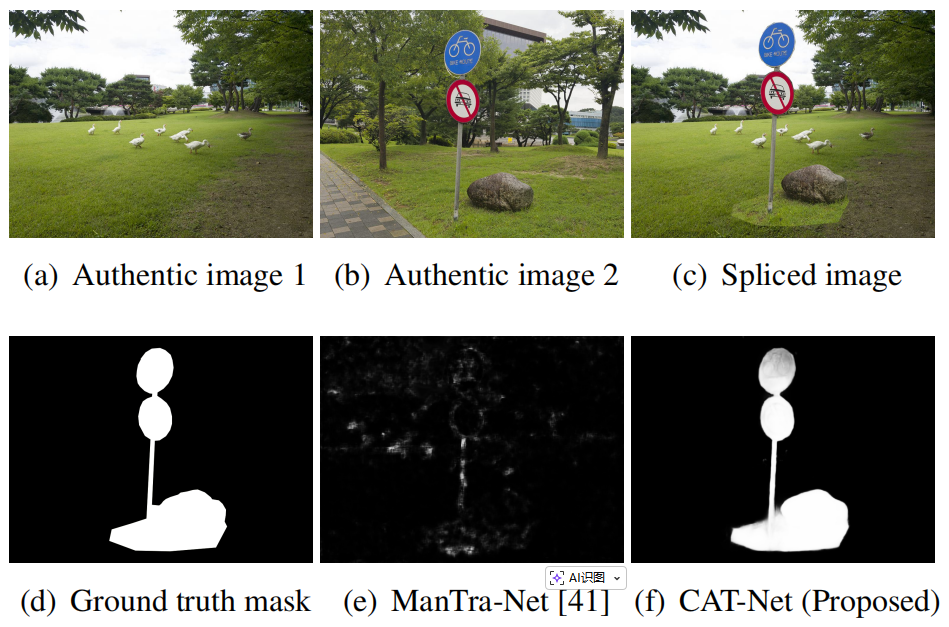

图1. JPEG图像中剪接区域定位的挑战。尽管ManTra-Net能够通过RGB像素追踪多种图像处理操作,但其在捕捉压缩伪影方面效果欠佳。本文提出的方法通过联合RGB域与离散余弦变换(DCT)域,有效追踪视觉线索与压缩痕迹。

图像拼接技术指将图像片段复制粘贴到其他图像上的操作(图1)[37],虽是最简单易行的图像处理方式之一,却也是恶意用途最普遍的手段。例如,有人会通过这种技术让人物出现在本不该出现的位置。本文重点研究图像拼接检测与定位技术:针对可能存在拼接痕迹的图像(图1(c)),我们的目标是生成能精确定位潜在篡改区域的掩膜图像(图1(d))。

要区分拼接区域与真实区域,关键在于分析由相机内部机制或图像编辑软件(如传感器图案噪声[22]、彩色滤光片阵列插值痕迹[30]、压缩伪影[2,26,38,40]等)产生的统计特征指纹。现代数码相机通常采用JPEG压缩技术来节省存储空间,因其高效性而被广泛使用。但这种压缩方式会导致信息丢失,从而产生各类JPEG伪影,尽管这些伪影通常肉眼不可见。因此,分析JPEG压缩伪影有助于定位伪造区域。

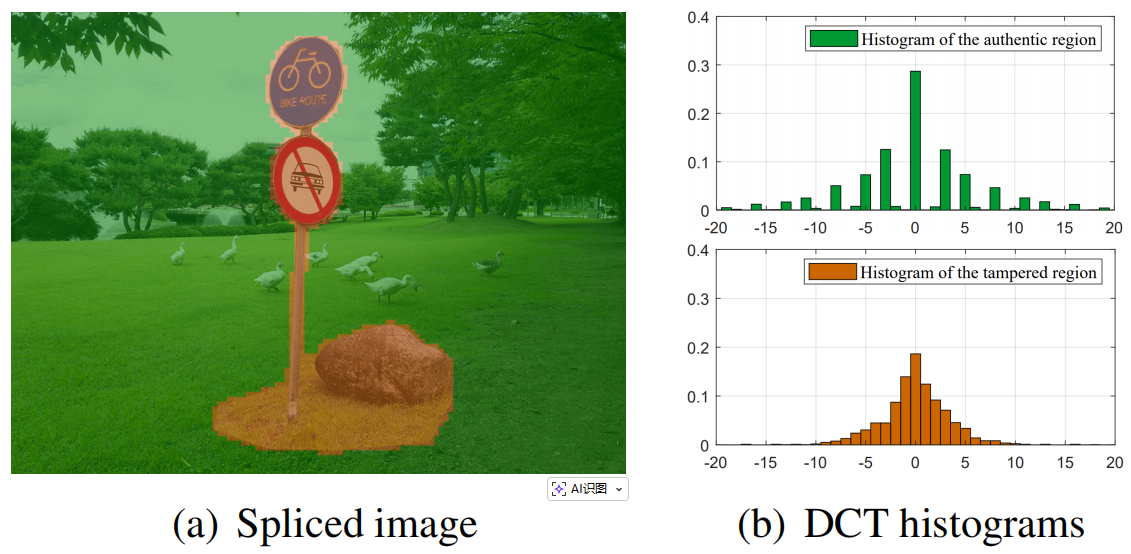

图2. 被篡改区域与真实区域之间的统计学差异。DCT直方图分别基于被篡改区域和真实区域在频率(2,1)处的Y通道DCT系数获得。

双重JPEG检测(即判断JPEG图像是否经过一次或两次压缩)有助于识别拼接伪造。与真实区域相比,拼接到另一图像上的区域在Y通道中的DCT系数分布很可能具有统计学差异(图2)。真实区域经过双重压缩:首先在相机中进行压缩,随后作为伪造内容再次压缩,从而在直方图中留下周期性模式[29]。拼接区域的压缩特性类似于单次压缩模式,遵循二次量化表[29]。传统上,DCT直方图被用于检测双JPEG压缩[7,21]。即便在深度学习时代,深度神经网络仍倾向于将预处理直方图作为输入[2,26,38,40],因为直接使用DCT系数作为输入通常效果不佳——与像素数据不同,DCT系数具有显著的去相关性[42]。由于依赖直方图分析,所有此类方法均会产生块级预测结果。为此,我们采用专为隐写分析设计的二值体积表征法来处理DCT系数,从而实现像素级预测[42]。该方案成功将语义分割网络与双JPEG检测技术相结合,实现了像素级预测功能。

本文提出了一种端到端全卷积神经网络——压缩伪影追踪网络(CAT-Net),用于检测并定位拼接区域。该网络包含RGB流、DCT流及最终融合阶段。RGB流用于学习视觉伪影特征,DCT流则用于学习压缩伪影特征(即DCT系数分布)。我们预先训练DCT流进行双JPEG检测,并将其作为拼接定位的初始化参数。融合阶段通过整合两路流的多分辨率特征,生成最终掩膜图像。

我们的主要贡献总结如下:

- CAT-Net首次实现了基于RGB和DCT域联合定位拼接对象的技术突破。通过与多种基准数据集进行的大规模实验表明,该网络相较于传统基线方法[41,15]取得了业界领先水平,并在JPEG与非JPEG图像处理中均保持稳定性能。

- 我们创新设计了DCT流处理机制,通过DCT系数的二值化体积表示来学习追踪双重压缩痕迹的压缩伪影特征。在检测双重JPEG压缩方面,该方法相较采用直方图表征的既有最优网络[2,26,40]展现出显著性能优势。

2.相关工作

图像伪造检测方法可分为块级分类、图像块匹配以及端到端神经网络方法三大类。

块级分类方法通过针对特定图像处理操作(如双JPEG压缩[2,26,38,40]、图像重采样[30]、对比度增强[36]及多重处理[4])进行块级分类来识别伪造图像分布。该方法将图像分割为若干固定尺寸的区块以定位篡改区域,并整合各区块的检测结果。由于每个区块的检测独立进行,因此无法得出整体图像统计特征。

图像块匹配技术通过提取图像块的统计特征并评估块间一致性,高度不一致的块会被判定为经篡改(例如从其他图像拼接而来)。预定义特征提取器[1,34]或神经网络[15,23]被用于提取匹配所需的特征。Huh等人[15]提出自监督学习方法,通过训练模型判断图像在 EXIF 元数据层面是否自洽。然而图像块匹配定位方法需要大量计算资源,因其需对所有块对进行一致性计算,并通过汇总结果进行耗时的后处理以确定实际伪造位置。

神经网络技术显著提升了目标检测[18,31,32]和语义分割[20,33,39]性能,因此基于此类技术的图像伪造定位方法已得到广泛应用。在文献[45]中,研究者将 SRM 核[11]引入目标检测模型,用于提取拼接伪造、复制移动伪造及删除伪造图像的边界框。Bi等人[5]提出基于U-Net[33]的分割网络实现图像拼接定位,该方法与常规语义分割网络类似,仅利用RGB像素域信息。Wu等人[41]开发的ManTraNet网络采用 SRM 核[11]进行特征提取,并通过约束卷积[4]后接像素级异常检测。尽管研究者将JPEG压缩视为特征提取器训练时的一种图像处理手段,但该方法无法区分单次与二次JPEG压缩差异,导致JPEG图像的定位性能出现下降。

我们提出了一种检测并定位JPEG图像中图像拼接的新方法,克服了先前研究的局限性。为实现快速推理及像素级预测,我们采用考虑多分辨率特征的分割网络[39]。为增强网络对JPEG压缩的鲁棒性,我们在DCT域中利用量化DCT系数的二值体积表示法[42]提取JPEG伪影。

3.提出的方法

3.1.网络结构

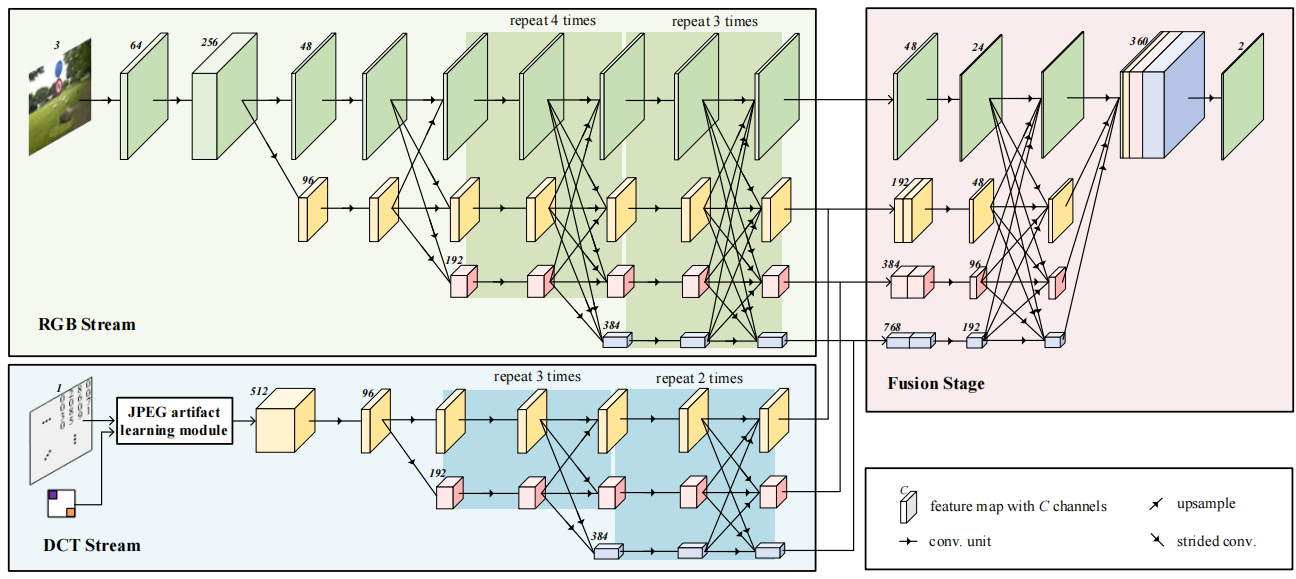

图3展示了CAT-Net的架构组成:包含RGB数据流、DCT数据流及最终融合阶段。系统从JPEG文件输入中提取RGB像素值、量化后的Y通道DCT系数以及Y通道量化表,其中RGB像素值输入RGB数据流,其他数据则输入DCT数据流。RGB数据流侧重捕捉视觉线索,DCT数据流则关注压缩伪影特征。通过融合两种数据流输出生成最终结果。

我们采用专为计算机视觉问题设计的HRNet[39]作为CAT-Net主干网络,并将其引入法医图像分析领域——该网络在整个处理过程中始终保持高分辨率特征表征,同时运用创新融合方法整合多分辨率特征以实现全局图像捕捉。这种方法既能完整捕捉整体结构特征,又不会丢失法医调查所需的精细细节。此外,HRNet采用步长为2的卷积运算进行特征图下采样,且未使用池化层。最新研究表明,在需要捕捉细微信号的任务中,池化操作会强化内容特征并抑制噪声类信号,因此并不适用[6]。虽然这种特性对计算机视觉任务具有优势,但对于法医取证任务而言却存在局限性——因为噪声信号本身就是关键证据线索。

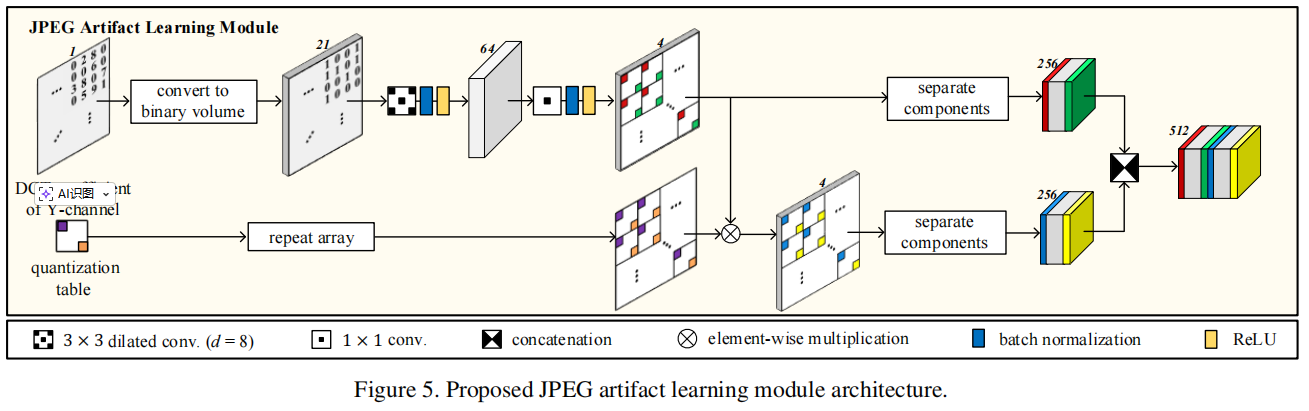

图3所示的CAT-Net架构包含RGB数据流、DCT数据流及最终融合阶段。RGB数据流以RGB像素作为输入,DCT数据流则以Y通道DCT系数及Y通道量化表作为输入。JPEG伪影学习模块如图5所示。

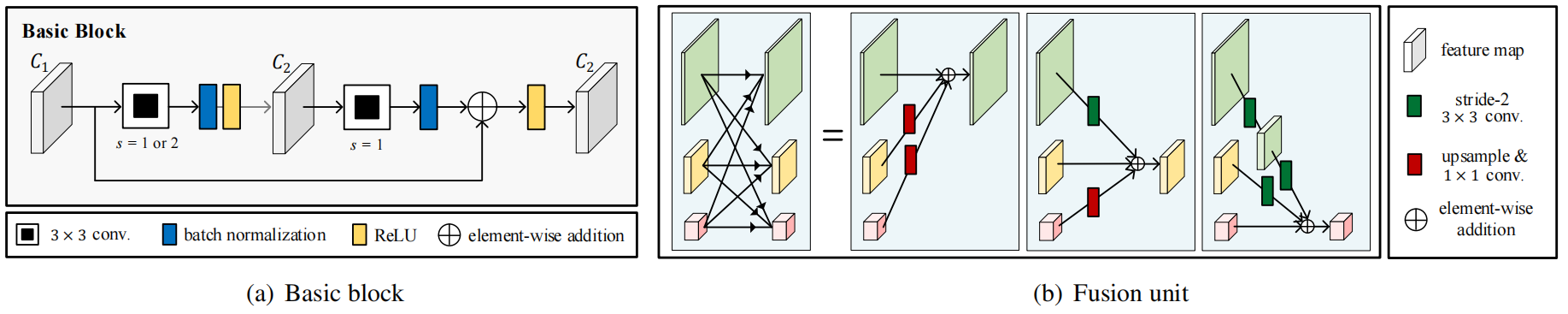

该网络包含两个核心组件:卷积单元与融合单元。如图3所示,每个卷积单元均由四个连续的基本模块构成(具体结构见图4(a)),仅首尾部分存在例外[39]。图4(b)展示了融合单元的工作原理:通过双线性插值(上采样)或滑动卷积(下采样)实现分辨率匹配后,对多分辨率特征图进行特征值求和运算,从而完成特征图的融合处理。

我们采用HRNet[39]作为CAT-Net的主干网络,该网络最初是为计算机视觉问题设计的。将HRNet引入法医领域具有双重优势:其一,该网络在整个处理过程中始终保持高分辨率特征表征;其二,通过创新融合方法整合多分辨率特征,有效捕捉整体图像特征。这种设计既能完整呈现案件整体结构,又不会丢失法医调查所需的精细细节。此外,HRNet采用步长为2的卷积层进行特征图下采样,且未使用池化层。最新研究表明,对于需要捕捉细微信号的任务而言,池化操作会强化内容特征并抑制噪声信号[6]。虽然这种特性在计算机视觉任务中具有优势,但对于法医取证任务却存在局限性:噪声信号往往是关键线索。

图4. 提出网络中的元件。图3中的卷积单元主要由四个连续的基本模块组成。融合单元通过在匹配分辨率后进行求和操作来融合多分辨率特征图。

该网络包含两个核心组件:卷积单元与融合单元。如图3所示,每个卷积单元均由四个连续的基本模块构成(具体结构见图4(a)),仅首尾部分存在例外[39]。图4(b)展示了融合单元的工作原理:通过双线性插值(上采样)或滑动卷积(下采样)实现分辨率匹配后,对多分辨率特征图进行特征值求和运算,从而完成特征图的融合处理。

RGB流结构与HRNet完全相同,仅省略了最后一部分。该RGB流以RGB像素值作为输入,首个卷积单元将分辨率降低四倍。从高分辨率路径开始,网络逐步构建从高到低的分辨率路径,并并行连接多分辨率路径。每个分辨率层级持续存在直至网络末端,最终生成1/4、1/8、1/16和1/32的分辨率输出。

图5. 提出的JPEG伪影学习模块架构

DCT流用于捕捉压缩伪影,即Y通道DCT系数的统计分布特征。该结构为HRNet的三分辨率变体,其首个卷积单元被替换为JPEG伪影学习模块(图5)。该流中所有卷积单元均包含四个基础模块(图4(a)),无一例外。

JPEG伪影学习模块首先将输入的DCT系数数组M通过变换f:ZH×W→{0,1}(T+1)×H×W转换为二值向量,使得

f(M)t,i,j={1,0,if abs(clip(M))i.i=tif otherwise

其中clip(·)函数按数组元素逐个裁剪至区间[T,T],abs(·)函数则逐元素取绝对值[42]。通过实验确定最优T值为20。这种二值体积表示法与DCT直方图[40]类似,但能使网络学习相邻DCT系数间的关联性。DCT直方图采用信息块级合并方式,而该表示法保持图像分辨率特性,适用于分割任务。

连续卷积运算被应用于二值化数据体。本文采用扩张卷积技术,该技术最初是为扩大卷积神经网络(CNN)感受野而设计[43]。但所提出的网络通过8维扩张卷积来提取基于相同频率基的离散余弦变换(DCT)系数特征。通过1×1卷积将特征图通道数缩减至4个,并采用特征图叉化结构。在叉化路径中,从JPEG头文件获取的8×8量化表与对应频率分量进行乘法运算。这与JPEG解码过程中对DCT系数进行去量化处理的流程类似。在另一路径中,数据表不会被乘法运算。两条路径均对每个64(=8×8)频带分量进行分离处理。需注意,前序操作均按频率维度执行,因此8×8块中的每个数值均代表一个频带分量。分量分离操作使数据结构从4×H×W维度扩展为256×H×8×W8维度,这会显著降低分辨率。最后在本模块中,两条路径生成的特征图会在通道维度进行拼接处理。输出结果将通过DCT流的剩余路径进行传输。

训练过程中,输入图像会被裁剪至固定尺寸以构建具有批量维度的张量。需要特别注意的是,矩形裁剪区域必须与8×8网格对齐,因为JPEG图像编码采用8×8块格式。这种设计使得通道分离张量的每个通道都能表征一个频率分量,同时使RGB流能够同时学习JPEG块效应伪影和视觉伪影特征。

输出特征图的分辨率分别为RGB流(1/4、1/8、1/6、1/32)和DCT流(1/8、1/16、1/32)。两路特征图在通道维度上按分辨率进行拼接后输入最终融合阶段(图3),该阶段结构与最终HRNet阶段完全相同,但通道数有所不同。所有四个分辨率的特征图最终均经过双线性上采样以匹配最高分辨率,完成拼接后输入最终卷积层。最终输出结果为每个类别(真实与篡改)对应的2×H4×W4维度的逻辑值数组。

3.2.非JPEG图像处理

虽然我们的网络以量化表作为输入,但该网络同样能够处理非JPEG格式图像。由于非JPEG图像不含量化DCT系数,其处理方式与JPEG编码器类似——均通过RGB像素进行计算。针对此类图像,我们将量化表设为全1值,对应JPEG质量等级100。为简化实现方案,我们在网络前端配置JPEG编码器,采用质量因子100的压缩方式对非JPEG图像进行处理,且不进行色度子采样。该过程会自动生成量化DCT系数及全为1的量化表。

该结论基于压缩假设:尽管拼接图像以未压缩图像格式保存,但用于拼接伪造的两幅原始(真实)图像在采集过程中最初已在相机中进行压缩。被篡改图像的文件扩展名无关紧要,即我们不假设伪造者以特定格式保存伪造图像。

3.3.双JPEG检测的预训练

DCT流权重通过双JPEG检测预训练进行初始化。该任务旨在判断给定JPEG图像经过一次或两次压缩处理。如图6所示,由于属于二分类任务,分类头被置于DCT流末端。基于该任务的预训练有助于流模型捕捉丰富的压缩伪影特征。

我们在包含105.4万张单压缩与双压缩JPEG图像的数据集上训练并测试了DCT流检测模型,这些图像具有混合质量参数[26]。实验中采用[3,8,13]文献提供的原始图像压缩方案,使用1,120个量化表进行压缩,不仅包含51个标准量化表(Q50-Q100),还整合了从其公开取证网络服务请求图像中获取的非标准量化表。表1显示所提出的DCT流检测模型在双JPEG图像检测中的准确率达到93.93%,相较于基线方法[40,2,26]已达到当前最优水平。尽管我们采用的系数范围较窄,但该网络性能仍优于使用直方图的现有最优神经网络[26]。因此,二值体积表征可作为DCT直方图在双JPEG检测中的有效替代方案。

我们还研究了不使用量化表乘法的网络结构,以评估量化表的应用效果。与原始DCT流相比,该方案去除了图5中量化表路径及拼接结构。量化表的应用显著提升了双JPEG检测精度,因此我们首次将量化表应用于伪造检测领域。

4.实验

4.1.数据集

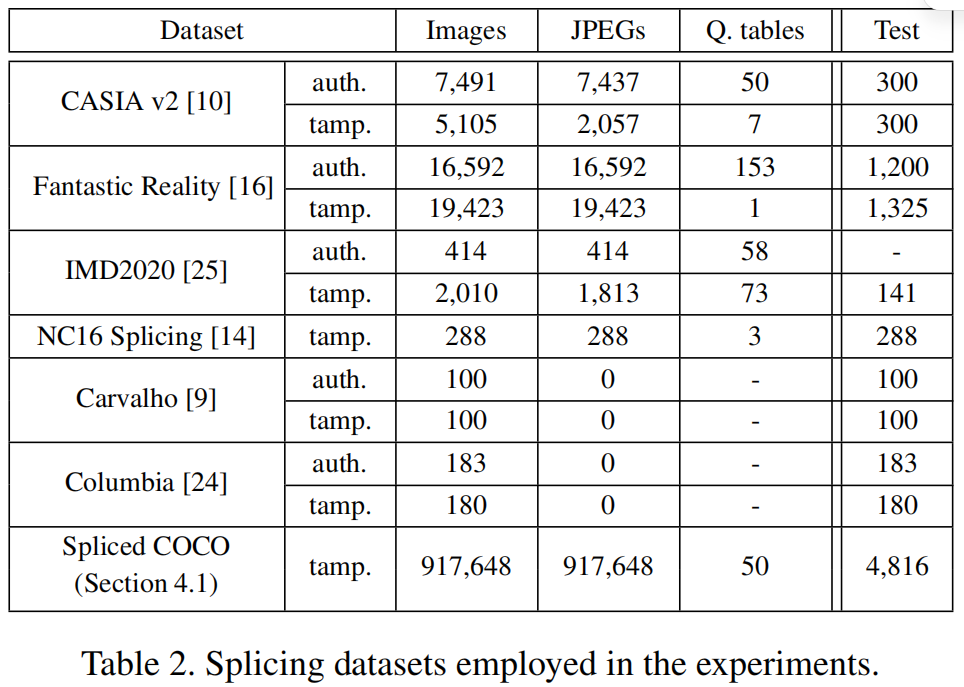

表2汇总了实验中使用的剪接数据集。我们首次报告了Y通道量化表的数量。

实验采用多种量化表(包括标准表和自定义表)以模拟真实世界的伪造场景。