Fusion_Transformer_with_Object_Mask_Guidance_for_Image_Forgery_Analysis

Fusion Transformer with Object Mask Guidance for Image Forgery Analysis

Dimitrios Karageorgiou1 Giorgos Kordopatis-Zilos2 Symeon

Papadopoulos1

1 信息科技研究所,CERTH

2 VRG, FEE, Czech

Technical University in Prague

摘要

在本研究中,我们提出了一种名为OMG-Fuser的融合式transformer网络,该网络通过从各类取证信号中提取信息,实现对图像伪造行为的精准检测与定位。相较于以往仅依赖少量信号且常忽视图像语义特征的传统方法,我们的方案能灵活处理任意数量的取证信号,并通过对象级信息进行分析。为此,我们设计了一种由对象注意力机制引导的transformer架构,通过关联描绘相同对象的图像块构建取证信号流,从而整合图像中的对象级信息。每个取证信号都经过专门设计的处理流程,根据其独特特征进行优化适配。令牌融合变换器能高效整合任意数量网络流的输出结果,为每个图像块生成融合表征。我们在现有方法基础上评估了两种融合方案:(i)分数级融合——整合多种图像取证算法的输出;(ii)特征级融合——直接整合低级取证痕迹。这两种方案在图像伪造检测与定位的七个数据集上均超越现有最优性能,F1值分别实现12.1%和20.4%的相对平均提升。我们的模型对传统及新型伪造攻击具有鲁棒性,且无需重新训练即可扩展新信号。

我们的代码在以下地址公开:https://github.com/mever-team/omgfuser

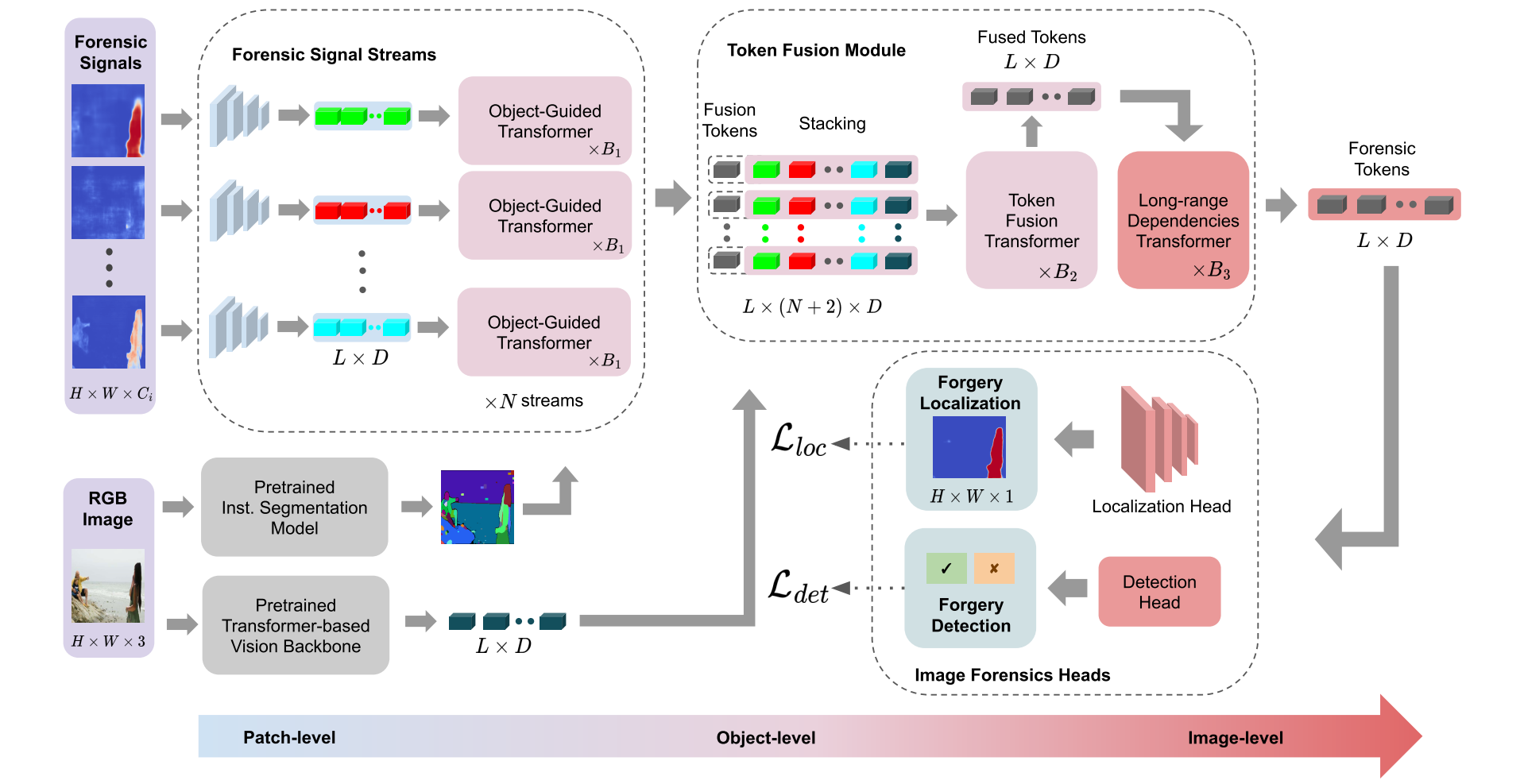

图2.OMG-Fuser系统架构示意图。该系统通过融合RGB图像与实例分割图谱中的特征信息,将法证信号转化为稳健的伪造定位掩膜和检测评分。具体实现时,每个法证信号和RGB图像首先通过独立的对象引导变换器(Object-Guided Transformers)进行网络流处理。随后,创新设计的令牌融合模块对不同数据流进行融合处理,使特征信息粒度逐步提升:从初始阶段的局部块级特征,到中间阶段的对象级特征,最终形成完整的图像级特征。定位模块与检测模块协同工作,对提取的法证令牌进行处理,最终生成输出结果。